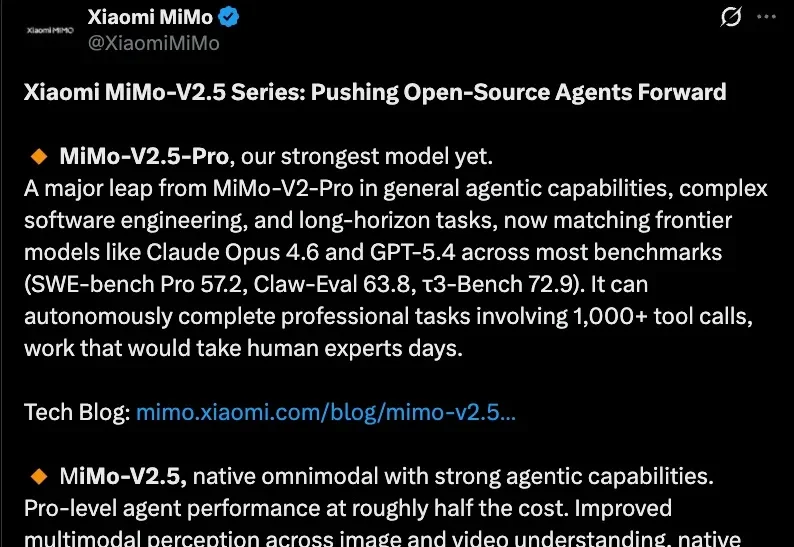

DeepSeek V4发布前,罗福莉亮剑!小米最强大模型MiMo-V2.5深夜突袭

DeepSeek V4发布前,罗福莉亮剑!小米最强大模型MiMo-V2.5深夜突袭小米大模型时隔一月能力飙涨,比Kimi K2.6省42% Token。

小米大模型时隔一月能力飙涨,比Kimi K2.6省42% Token。

开源AI王座一夜易主!Kimi K2.6出道即巅峰,展示了恐怖的「全栈交付」能力。它不仅能复刻高盛研报、手搓奢华官网,甚至能和人类在群组里并肩打工。

月之暗面昨天发布了 Kimi K2.6,代码能力和 Agent 能力都有明显增强。官方数据很亮眼:13 小时不间断编码、4000 行代码重构、LMArena 全球开源第一。

Kimi 刚刚发布了 K2.6,Agent 模式也同步大升级。

今天,我们发布并开源 Kimi K2.6 模型,带来行业领先(state-of-the-art)的代码、长程任务执行和 Agent 集群能力。Kimi K2.6 现已上线 kimi.com、最新版 Kimi 应用、Kimi API 和 Kimi Code 编程助手,所有用户都可以开始使用。

刚测完 Kimi K2.5,就拿到 Beta 版内测模型了。 一点喘息的机会都不给啊~~

今天,智谱正式开源其最强模型GLM-5.1,这一模型在专业软件开发基准测试SWE-Bench Pro中,GLM-5.1刷新全球最佳成绩,得分达到58.4,超过了GPT-5.4、Claude Opus 4.6等已经正式发布的闭源模型,和MiniMax M2.7、Kimi K2.5等开源模型。

如果你是 Kimi Code 会员,现在就可以去控制台申请抢先体验——据说能提前体验新模型。消息虽非官方,但足以让开发者兴奋。毕竟,Kimi K2.5 接入 Kimi Code 才过去不到两个月。

本报告基于XSCT Arena平台,对 Qwen3.6-Plus-Preview(阿里云,2026-04-02 发布)在文字能力(xsct-l)、网页生成(xsct-w)、Agentic 任务(xsct-a)三大场景下的表现进行系统评测,并与Claude Sonnet 4.6、GPT-5.4、Gemini 3.1 Pro、Kimi K2.5、

3月30日,界面新闻记者从知情人士处独家获悉,3月初,在Kimi K2.5模型发布一个月之后,月之暗面ARR(年度经常性收入)突破1亿美金。知情人士还表示,K2.5模型上线后,API供应的TPM(Tokens Per Minute,每分钟令牌数)配额迅速趋紧,有客户开出千万美元级别的消费承诺及预付担保,以期获得优先供应。